《实战AI大模型》AI数字人应用-第03节:基于Awesome-Digital-Human-Live打造AI数字人

作者:冰河

星球:http://m6z.cn/6aeFbs

博客:https://binghe.site

文章汇总:https://binghe.site/md/all/all.html

源码获取地址:https://t.zsxq.com/0dhvFs5oR

大家好,我是冰河~~

在AI技术飞速发展的今天,数字人已经从概念走向现实。你是否想过拥有一个能够实时对话、表情生动的专属AI数字人?今天,我们一起探索如何基于Awesome-Digital-Human-Live2D项目,从零开始打造一个功能完整的交互式数字人。

Awesome-Digital-Human-Live2D 是一个优秀的开源数字人交互平台,它通过Docker容器技术实现了快速部署,集成了语音识别、大语言模型对话、语音合成等核心模块。无论你是想快速体验数字人交互,还是基于此进行二次开发,这个项目都能提供坚实的基础。

本节awesome-digital-human-live2d项目地址:https://github.com/binghe001/awesome-digital-human-live2d

官方awesome-digital-human-live2d项目地址:https://github.com/wan-h/awesome-digital-human-live2d

一、数字人效果展示

在深入了解技术实现之前,让我们先看看这个数字人平台能带来什么样的交互体验。

在PC端,你可以看到一个精美的Live2D角色,支持丰富的动作表情和背景切换,营造出沉浸式的对话环境:

平台还完美适配移动端,随时随地与数字人聊天:

二、为什么选择Live2D

在众多数字人项目中,我选择推荐Awesome-Digital-Human-Live2D,主要基于以下几个关键考量:

2.1 极致的轻量化部署

很多数字人项目对硬件要求极高,动辄需要高端GPU和大内存。而这款工具最低仅需2核CPU和4GB内存,这意味着即使是普通的个人电脑或入门级云服务器也能流畅运行,大大降低了体验和开发的门槛。

2.2 模块化的灵活架构

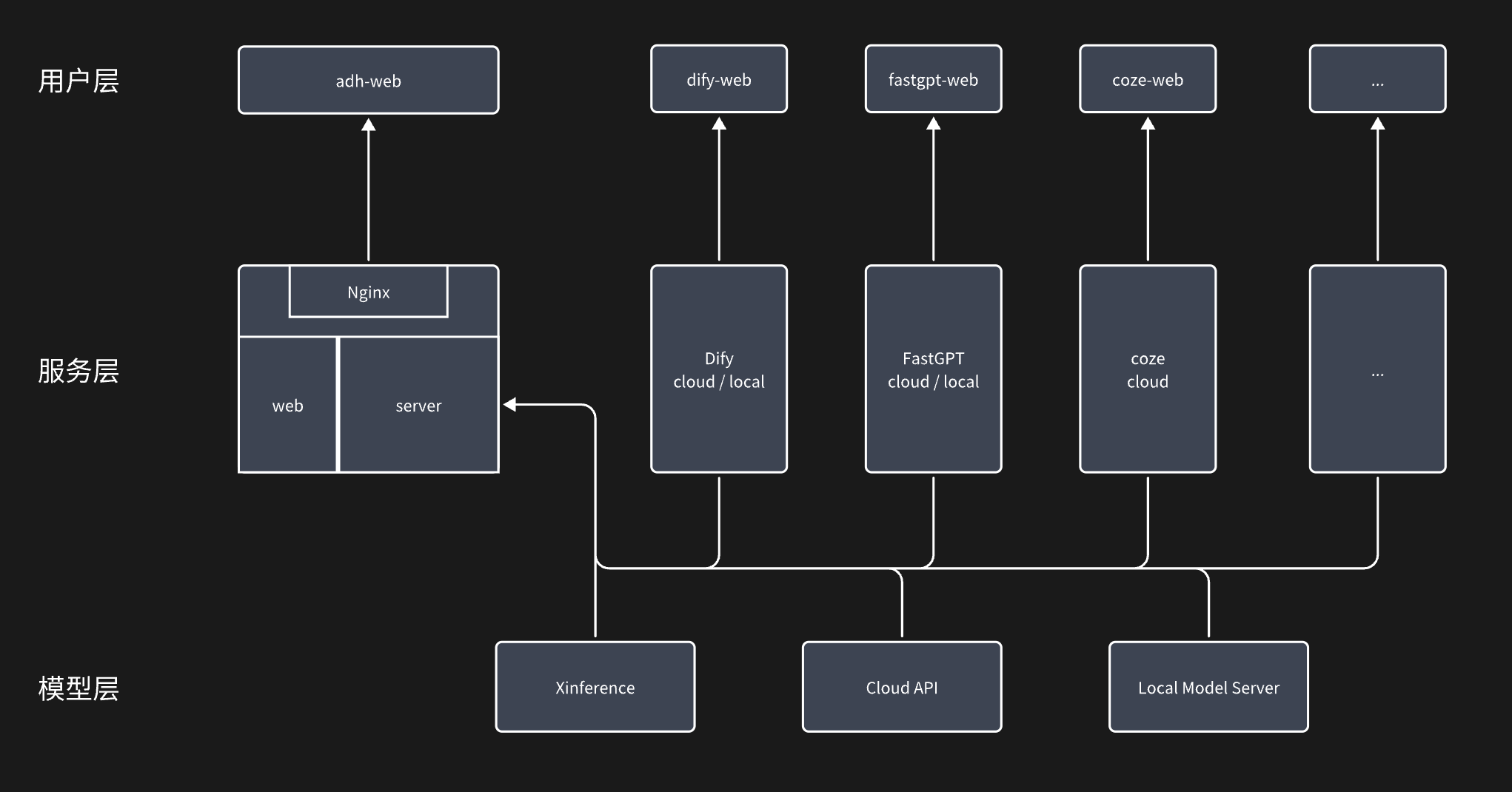

项目采用清晰的模块化设计,ASR(语音识别)、LLM(大语言模型)、TTS(语音合成)三大核心引擎都可以灵活替换。它已经原生集成了对Dify、Coze、FastGPT等流行AI服务的支持,让你可以轻松切换不同的智能后端。

2.3 丰富的交互模式

平台提供了两种主要的交互模式:

- 对话模式:传统的文字输入输出,适合需要精确控制或记录对话内容的场景。

- 沉浸模式:真正的实时语音交互,数字人会“听”到你说话并“开口”回答,体验更加自然生动。

2.4 出色的跨平台兼容性

基于Web技术构建,意味着你可以在任何有浏览器的设备上访问——无论是Windows、macOS电脑,还是iOS、Android手机,都无需安装额外的客户端应用。

三、技术架构深度解析

要真正用好这个工具,了解其内部架构是很有帮助的。项目采用了经典的前后端分离设计,各模块职责清晰,便于理解和定制。

核心目录结构解析:

digitalHuman/core/:这里是数字人的“大脑”,包含了所有的核心交互逻辑和控制流程。digitalHuman/agent/:定义了不同的交互代理,每种代理对应一种AI服务后端(如Dify、FastGPT等)。digitalHuman/engine/:引擎扩展接口,如果你想接入自己的语音识别或合成服务,可以在这里进行扩展。

这种架构设计的最大好处是高内聚、低耦合。你可以轻松替换任何一个模块而不影响其他部分的功能。

四、四步快速部署实战

理论了解得差不多了,现在让我们动手搭建属于自己的数字人平台。

4.1 环境准备检查

查看完整文章

加入冰河技术知识星球,解锁完整技术文章、小册、视频与完整代码